OpenAI 推出 GPT-4o 新功能一覽

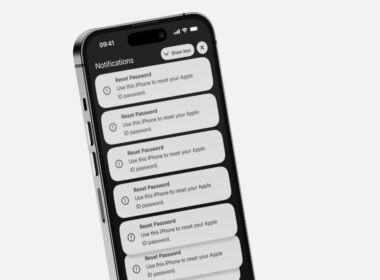

OpenAI 在今日的春季發佈活動中,宣佈推出最新發佈的 GPT-4o Model,當中 (“o”代表“omni”)這標誌著在更自然和多樣化的人機互動方面取得了重大進展。 反應速度更快 GPT-4o的一個突出特點是其對音頻輸入的快速反應時間。它可以在僅232毫秒內做出回應,平均反應時間為320毫秒,這與人類的對話速度非常接近。這一改進使得GPT-4o成為現有模型中更高效的替代品,提供更快且更具成本效益的性能。具體來說,它在英語文本和編碼方面達到了GPT-4 Turbo 的水準,在非英語語言方面表現出色,並且處理請求的成本顯著降低——通過API便宜50%。 聲畫處理能力提升 GPT-4o在視覺和音頻理解方面的進步尤其值得注意。之前的模型,如使用 Voice Mode 的 GPT-3.5 和 GPT-4,處理音頻輸入需要多步驟過程,導致更高的延遲(GPT-3.5為2.8秒,GPT-4為5.4秒)且丟失了很多上下文信息。這些模型使用單獨的系統來將音頻轉錄為文本、處理文本以及將文本轉換回音頻,這限制了它們識別語氣、處理多個講話者或解釋背景噪音的能力。 即時語音對話功能…