Ollama 是一款廣受歡迎的應用程式,用於在電腦上本地運行 AI 模型。最近,Ollama 發佈了一項更新,充分利用了 Apple 自家的機器學習框架 MLX。這項更新為配備 Apple silicon 晶片的 Mac 帶來了顯著的效能提升。

重點文章

效能提升與技術特點

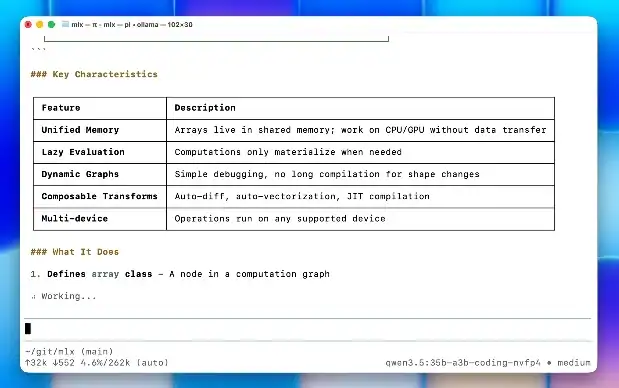

根據 Ollama 表示,新版本在提示詞處理速度(預填充速度)方面提升了約 1.6 倍,而生成回應的速度(解碼速度)則幾乎翻倍。據稱,配備 M5 系列晶片的 Mac 受惠最大,這得益於 Apple 新的 GPU 神經加速器。此次更新還包含更智能的記憶體管理,這應能讓 AI 驅動的編碼工具和聊天助理在長時間使用時,反應更為靈敏。

應用場景與未來展望

Ollama 指出,這次效能提升預計將特別造福那些在 macOS 上運行個人助理(如 OpenClaw)或編碼代理(如 Claude Code、OpenCode 或 Codex)的用戶。此預覽發佈版本為 Ollama 0.19,用戶需確保其 Mac 擁有超過 32GB 的統一記憶體方可運行。目前,該版本僅支援阿里巴巴的 Qwen3.5 模型,但 Ollama 表示未來計劃支援更多 AI 模型。