Meta 於今日(2026 年 4 月 8 日)正式發表了由旗下超級智慧實驗室(Meta Superintelligence Labs)所開發的全新大型語言模型——Muse Spark。作為新一代 Muse 系列的首發之作,Muse Spark 雖然在設計上主打輕量與快速,卻具備極高的複雜推理能力,並將全面驅動升級版的 Meta AI 助理,為使用者帶來更貼近真實世界的多模態互動體驗。

重點文章

雙重模式與「平行處理」

升級後的 Meta AI 助理將搭載「即時 (Instant)」與「思考 (Thinking)」兩種模式,讓使用者能根據問題的難易度靈活切換。最令人矚目的突破在於,Muse Spark 賦予了 Meta AI「平行處理」的能力。面對複雜的任務(例如規劃家庭旅遊),系統能同時啟動多個「子代理程式 (subagents)」,分別負責安排行程、比較景點與搜尋活動,大幅縮短運算時間並提供更完善的解答。

強大的「多模態感知」與視覺生成

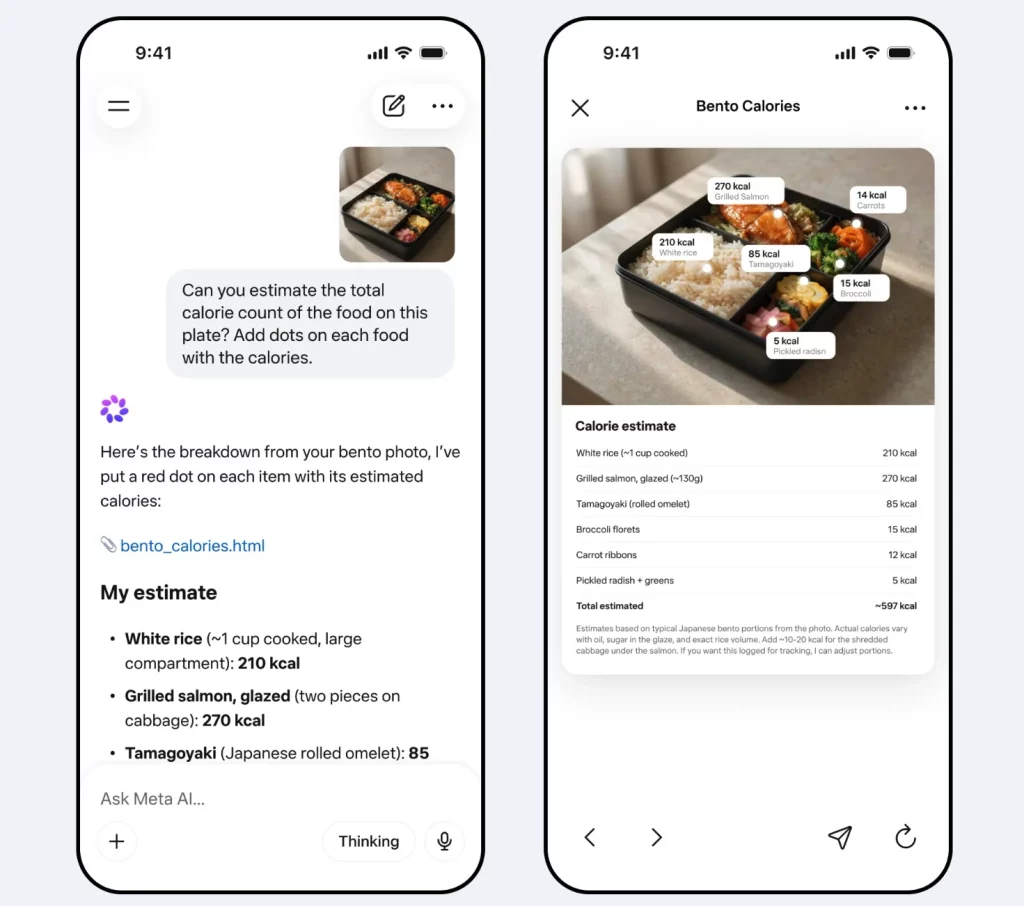

Muse Spark 不再侷限於文字對話,它具備強大的「多模態感知 (Multimodal Perception)」能力,能真正「看懂」世界。使用者只需拍下照片,AI 就能辨識商品規格、分析零食的營養成分,甚至能看懂健康圖表並提供醫療相關的參考資訊(Meta 為此特別與醫師團隊合作開發)。

此外,Muse Spark 在「視覺化程式設計 (Visual Coding)」的表現也相當優異。使用者只需輸入簡單的文字指令,就能讓 AI 瞬間生成客製化網站,或是直接寫出一款可以與朋友分享的復古街機小遊戲。

深度整合社群生態

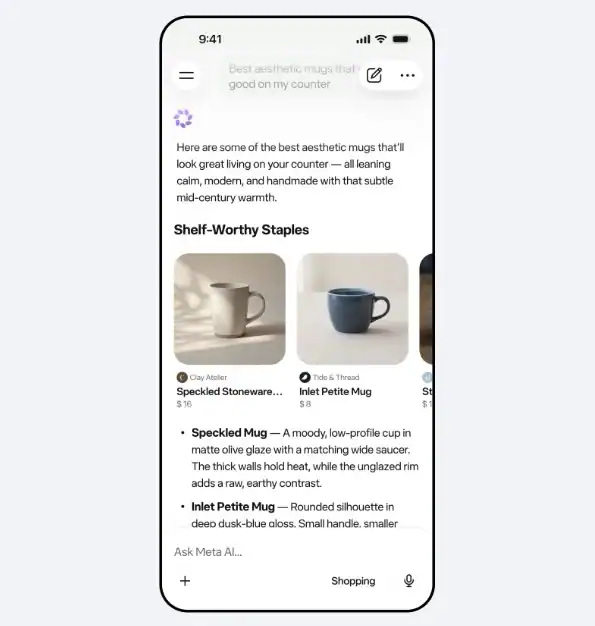

有別於其他 AI 模型,Muse Spark 最大的優勢在於其背後龐大的 Meta 社群生態。全新推出的「購物模式」會自動從使用者追蹤的創作者與社群中汲取靈感;當使用者詢問旅遊地點或熱門話題時,Meta AI 甚至能直接調用來自 Facebook、Instagram 和 Threads 上在地民眾的真實貼文,提供最具「人情味」與實用性的上下文資訊。

未來將整合至智慧眼鏡與開放 API

目前,Muse Spark 已在美國地區的 Meta AI App 與官方網站上線。Meta 表示,未來幾週內,這項新技術將陸續推展至全球,並全面整合進 WhatsApp、Instagram、Facebook、Messenger 以及 Meta AI 智慧眼鏡中,讓 AI 的視覺感知能力在穿戴裝置上發揮最大潛力。

同時,Meta 也宣布將透過 API 的形式,開放特定合作夥伴進行非公開預覽,並期許未來能將 Muse 系列的後續版本開源,持續推動 AI 技術的普及與發展。